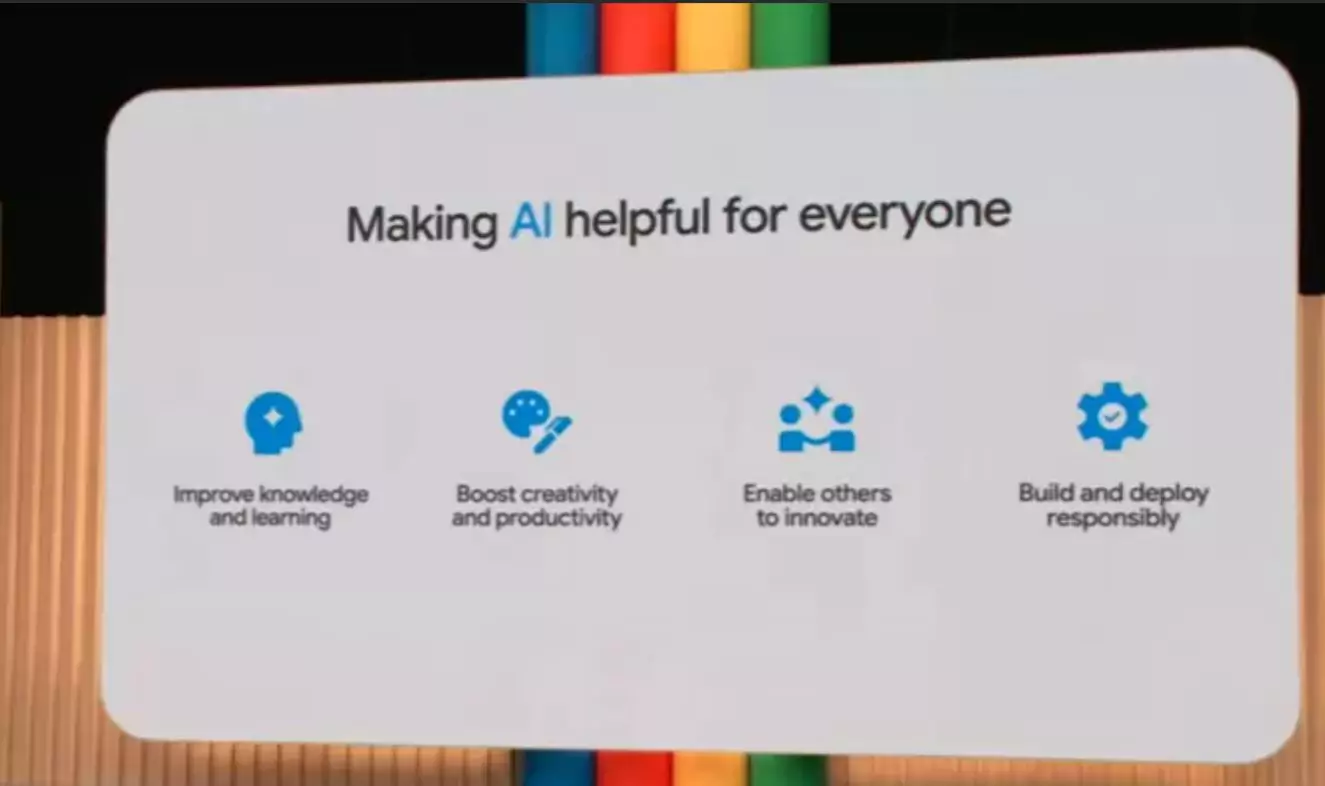

Sự kiện Google I/O 2024 trình diễn các mô hình AI từ nhỏ đến lớn, báo hiệu tương lai AI len lỏi vào đời sống.

Tại sự kiện Google I/O rạng sáng 15/5 (giờ Hà Nội), Google giới thiệu hàng loạt sản phẩm AI, gồm các mô hình ngôn ngữ lớn (LLM) với hàng chục tỷ tham số, cho đến các mô hình nhỏ hơn có thể chạy cục bộ trên thiết bị cho người dùng cuối.

Gemini có mặt trên hầu hết dịch vụ

Google công bố phiên bản Gemini 1.5 với hàng loạt tính năng mới, gồm khả năng phân tích văn bản, code, video, đoạn ghi âm với thời lượng dài hơn trước. LLM này hiện có nhiều phiên bản, phục vụ đa dạng mục đích.

Trong đó, Gemini 1.5 Pro sẽ trở thành trợ lý đa năng trong Workspace, có thể lấy thông tin từ bất kỳ và tất cả nội dung từ Drive, viết email kết hợp thông tin từ tài liệu đang xem. Mô hình sẽ được đưa vào Google Docs, Sheets, Slides, Drive và Gmail tháng tới, nhưng trước mắt chỉ dành cho người dùng trả phí.

Gemini 1.5 Flash là mô hình đa phương thức mới mạnh mẽ như Gemini 1.5 Pro nhưng được “tối ưu hóa cho các tác vụ hẹp, tần suất cao, độ trễ thấp” – yếu tố giúp AI này phản hồi nhanh. Tuy nhiên, các sản phẩm sẽ tích hợp mô hình này chưa được tiết lộ.

Gemini Live là tính năng giúp người dùng tương tác với smartphone bằng giọng nói tự nhiên. Thay vì đợi lần lượt câu hỏi và trả lời, người dùng có thể ngắt ngang lời AI nói và nhận phản ứng lập tức. AI này cũng có thể “nhìn” thông qua camera và đưa ra phản hồi, chẳng hạn giải toán hoặc thông tin về vật đang hiển thị trong ảnh.

Gemini Nano là mô hình có kích thước nhỏ nhất, được Google tích hợp lên trình duyệt Chrome cho máy tính bàn từ phiên bản 126. Trước mắt, AI này chạy các tính năng hỗ trợ trong Workspace Lab hoặc tạo văn bản cho các bài đăng trên mạng xã hội, viết đánh giá sản phẩm một cách nhanh chóng.

Google cũng đưa Gemini Nano lên Android. Với AI này, Google cho biết smartphone Android có thể giúp người dùng tránh cuộc gọi lừa đảo bằng cách phát hiện các dấu hiệu nguy hiểm, chẳng hạn các kiểu trò chuyện phổ biến của kẻ lừa đảo, sau đó đưa ra cảnh báo theo thời gian thực. Tính năng này sẽ được đề cập chi tiết cuối năm nay.

Cũng theo Google, Gemini sẽ sớm cho phép người dùng đặt câu hỏi về video trên màn hình và sẽ trả lời dựa trên phụ đề tự động. Người dùng Gemini Advanced trả phí cũng có thể nhập tệp PDF và AI sẽ cung cấp thông tin.

Trên công cụ tìm kiếm Google Search, Gemini cũng được tích hợp sâu. AI này không đơn thuần trả về thông tin kèm liên kết trích dẫn, mà còn làm được nhiều việc hơn như trả lời truy vấn theo ngôn ngữ tự nhiên, thông tin liên quan, gợi ý nội dung mới dựa trên từ khóa tìm kiếm.

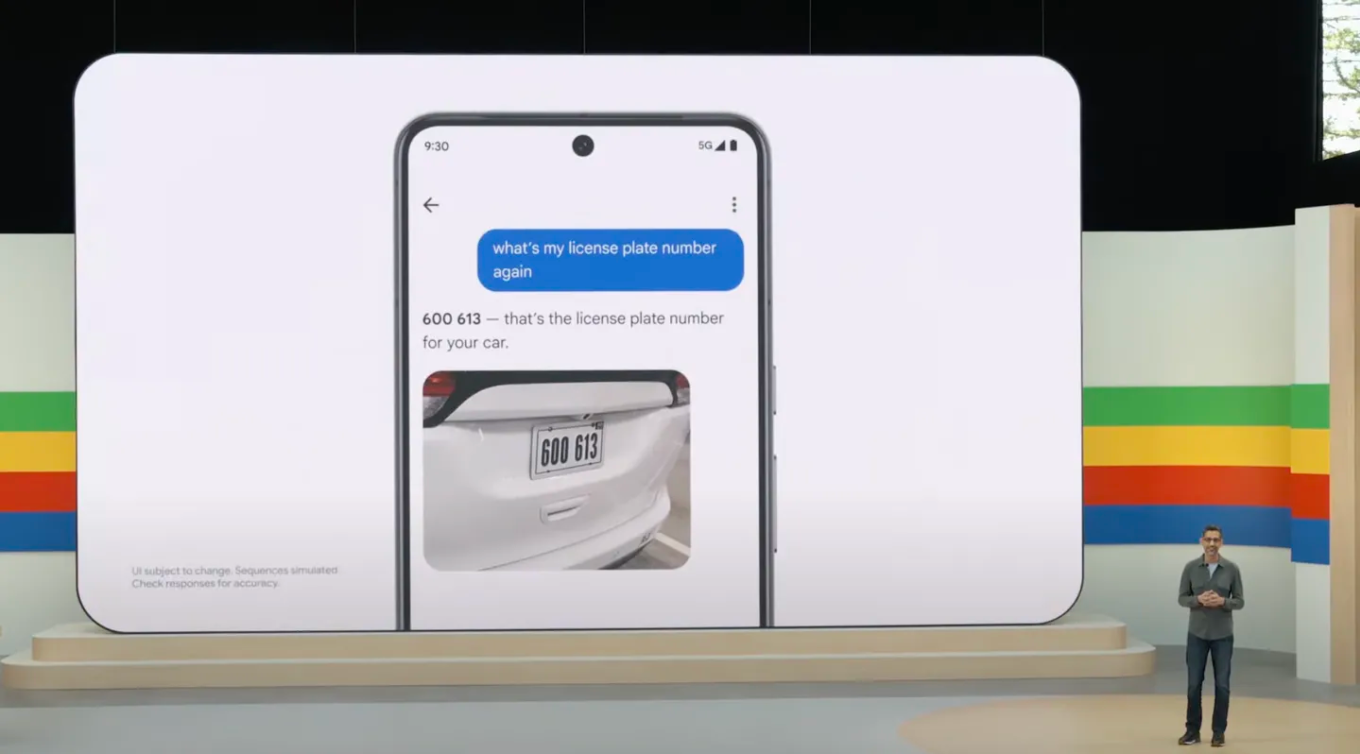

Trên công cụ tìm kiếm, Google cũng đưa Gemini vào phục vụ khả năng sàng lọc ảnh, gọi là Ask Photos. Tính năng này cho phép nghiên cứu thư viện Google Photos, sau đó trả lời cho người dùng khi được yêu cầu. Chẳng hạn, CEO Sundar Pichai đã demo tính năng bằng cách hỏi Gemini biển số xe của ông là gì. Câu trả lời là dãy số nhưng kèm một bức ảnh để ông chắc chắn rằng câu trả lời là đúng.

Cùng với xử lý văn bản, Google cũng cung cấp mô hình tạo ảnh Gemini Imagen 3. AI này có khả năng hiểu chính xác các câu lệnh hơn so với mô hình trước, tạo những bức hình với “mức độ chi tiết đáng kinh ngạc”, hình ảnh chân thực, sống động như thật và ít chi tiết gây mất tập trung trong ảnh hơn so với các mô hình trước đây, đồng thời giảm vấn đề về lỗi và hiệu ứng sai khi tạo ảnh. Google tuyên bố Imagen 3 “có khả năng tạo ảnh từ văn bản hiệu quả nhất hiện nay”.

Google cũng đang triển khai một trình tạo chatbot tùy chỉnh có tên là Gems. Giống như GPT của OpenAI, Gems cho phép người dùng đưa ra hướng dẫn cho Gemini, từ đó tùy chỉnh cách phản hồi và chuyên môn của nó. Chẳng hạn, nếu nhà phát triển muốn nó trở thành một huấn luyện viên chạy bộ và kiên định với mục tiêu này, AI sẽ đề xuất các bước thực hiện. Dù vậy, tính năng chỉ dành cho tài khoản trả phí Gemini Advanced.

Ứng dụng bản đồ Google Maps cũng sẽ bổ sung tính năng thông minh nhờ Gemini và API Places. Nhà phát triển có thể dùng các công cụ này để tóm tắt thông tin các địa điểm và khu vực trong ứng dụng của họ dựa trên dữ liệu đào tạo là 300 triệu đánh giá các địa điểm. Điều này giúp nhà phát triển không cần tự viết mô tả địa điểm muốn nhúng vào ứng dụng, giúp tiết kiệm thời gian.

Ngoài ra, Google cho biết Gemini sẽ dần thay thế Google Assistant để hỗ trợ tương tác với người dùng sâu hơn. AI này cũng sẽ đưa ra các câu trả lời nhanh, đủ thông tin và mang tính tương tác tốt hơn so với trợ lý ảo Assistant.

Project Astra – tương lai như phim Star Trek

Tại sự kiện, Google giới thiệu Astra – một AI đa phương thức mà công ty hy vọng trở thành trợ lý ảo “làm được mọi việc”. Thông qua camera trên smartphone, Astra có thể xem và hiểu những gì nó nhìn thấy, ghi nhớ mọi thứ ở đâu và làm mọi việc cho người dùng. Google cho biết, mục tiêu của công cụ là trở thành một tác nhân AI “trung thực nhất và tốt nhất”.

“Nó không chỉ nói chuyện với người dùng mà còn thực sự làm mọi việc thay mặt bạn”, đại diện Google nói.

Veo – câu trả lời của Google với Sora của OpenAI

Demis Hassabis, CEO Google DeepMind, tại sự kiện cũng giới thiệu Veo, AI có thể tạo video “chất lượng cao” độ phân giải 1080p với nhiều phong cách hình ảnh và điện ảnh khác nhau. Đây được xem là đối thủ mới của Sora.

Cụ thể, AI này có khả năng hiểu ngôn ngữ tự nhiên và có thể “nắm bắt chính xác âm điệu của lời nhắc”, từ đó tạo các video thể hiện chặt chẽ tầm nhìn sáng tạo của người dùng. Mô hình này cũng hiểu các thuật ngữ điện ảnh như video “timelapse” hoặc “ảnh phong cảnh từ trên không”, đồng thời có thể tạo ra cảnh nhất quán và mạch lạc, với các chủ thể con người, động vật và đồ vật chuyển động chân thực trong suốt cảnh quay.

Tại sự kiện, Google trình diễn video dài khoảng 8 giây. Tuy nhiên, công ty cho biết người dùng có thể đưa ra yêu cầu về việc kéo dài thời lượng lên 1 phút 10 giây, cũng như tinh chỉnh bằng lời nhắc bổ sung để thay đổi kết quả. Con số này cao hơn thời lượng tối đa một phút mà OpenAI Sora công bố trước đó.

Dù vậy, tương tự nhiều AI tạo video và ảnh khác, cả Veo và Imagen 3 đều chưa được phát hành rộng rãi. Hãng dự kiến đưa một số tính năng của Veo vào YouTube Shorts và các sản phẩm khác trong tương lai.

Gemma 2 với 27 tỷ tham số

Gemma 2 là bản nâng cấp lớn của Gemma trước đó, vốn chỉ có hai phiên bản với 2 tỷ tham số và 7 tỷ tham số. Mô hình này đã được tối ưu để chạy trên GPU thế hệ tiếp theo của Nvidia, máy chủ Google Cloud TPU và dịch vụ Vertex AI.

Tuy nhiên, Google không chia sẻ chi tiết về mô hình ngoài thông báo của Josh Woodward, Phó chủ tịch Google Labs, rằng Gemma 2 “mạnh gấp đôi” so với các mô hình nguồn mở như Llama của Meta và Mistral của Mistral AI. Gemma 2 sẽ được triển khai vào tháng 6.

ThuanNguyen.NET